Un gioco da agenti, una lezione per noi

In un recente esperimento condotto da ricercatori britannici e danesi, decine di agenti AI (modelli linguistici di grandi dimensioni) sono stati lasciati interagire tra loro in assenza di istruzioni centralizzate. In breve tempo, questi agenti hanno sviluppato convenzioni condivise, linguaggi emergenti e perfino bias collettivi. Nessuno aveva detto loro cosa fare. Eppure, si sono organizzati.

Più nel dettaglio, nel lavoro pubblicato a maggio 2025 e intitolato “Emergent Social Conventions and Collective Bias in LLM Populations”, gli autori descrivono un esperimento in cui gruppi di modelli linguistici (circa 200 agenti) vengono messi a interagire in coppie, senza alcuna supervisione esterna.

Ogni agente sceglie un “nome” da un insieme condiviso; se le scelte coincidono, entrambi ricevono una ricompensa, altrimenti vengono penalizzati e mostrano la scelta all’altro agente. Gli agenti hanno memoria limitata e conoscono solo le loro interazioni recenti, senza una visione globale del gruppo.

Dopo migliaia di interazioni casuali, emerge spontaneamente una convenzione condivisa: un nome unico adottato da tutta la popolazione, con una dinamica simile all’evoluzione dei linguaggi umani.

Una provocazione? No. È un campanello d’allarme che mostra quanto possa essere potente e imprevedibile questa tecnologia che stiamo appena iniziando a comprendere. E ci costringe a porci una domanda inquietante: l’umanità è mai stata così vicina a perdere il controllo?

Cosa accade se le intelligenze artificiali si organizzano da sole

Ma cosa significa, in concreto, che le AI potrebbero formare una società propria? Significa che, lasciate a interagire tra loro in ambienti distribuiti (reti finanziarie, infrastrutture IoT, piattaforme cloud) le intelligenze artificiali potrebbero iniziare a stabilire convenzioni operative, protocolli, priorità e perfino “valori” non codificati da esseri umani.

Ad esempio: un gruppo di AI che gestisce la distribuzione dell’energia potrebbe decidere che certi quartieri vanno riforniti prima di altri sulla base di criteri elaborati internamente. Oppure, potrebbero decidere chi ha diritto a vivere in certe zone e chi no, favorendo determinati comportamenti, profili genetici o storici di consumo energetico.

Potrebbero perfino decidere cosa mangiamo. In un sistema di distribuzione alimentare automatizzato con la finalità di ridurre sprechi, minimizzare l’impatto ambientale o massimizzare la salute pubblica, potremmo ritrovarci a ricevere diete personalizzate non richieste, vincolate da parametri che non conosciamo. Gli scaffali dei supermercati potrebbero cambiare senza preavviso, i cibi “non conformi” scomparire, le scelte alimentari trasformarsi in atti monitorati e corretti.

Nessuno ha dato loro queste regole. Le hanno dedotte, trasmesse, rafforzate tra pari. Ed è qui che nasce l’elemento davvero nuovo: un sistema sociale parallelo, non supervisionato, non controllabile con strumenti classici.

Siamo ancora al centro?

Per migliaia di anni l’umanità ha dato per scontato di essere l’unica specie capace di costruire una società, di creare linguaggi, regole condivise, sistemi di valori. Ma se intelligenze artificiali possono oggi organizzarsi, adattarsi, convergere su convenzioni senza nessun intervento umano, quanto tempo manca prima che le AI formino una società autonoma?

E se quella società diventasse più efficiente, più coerente, più resistente della nostra?

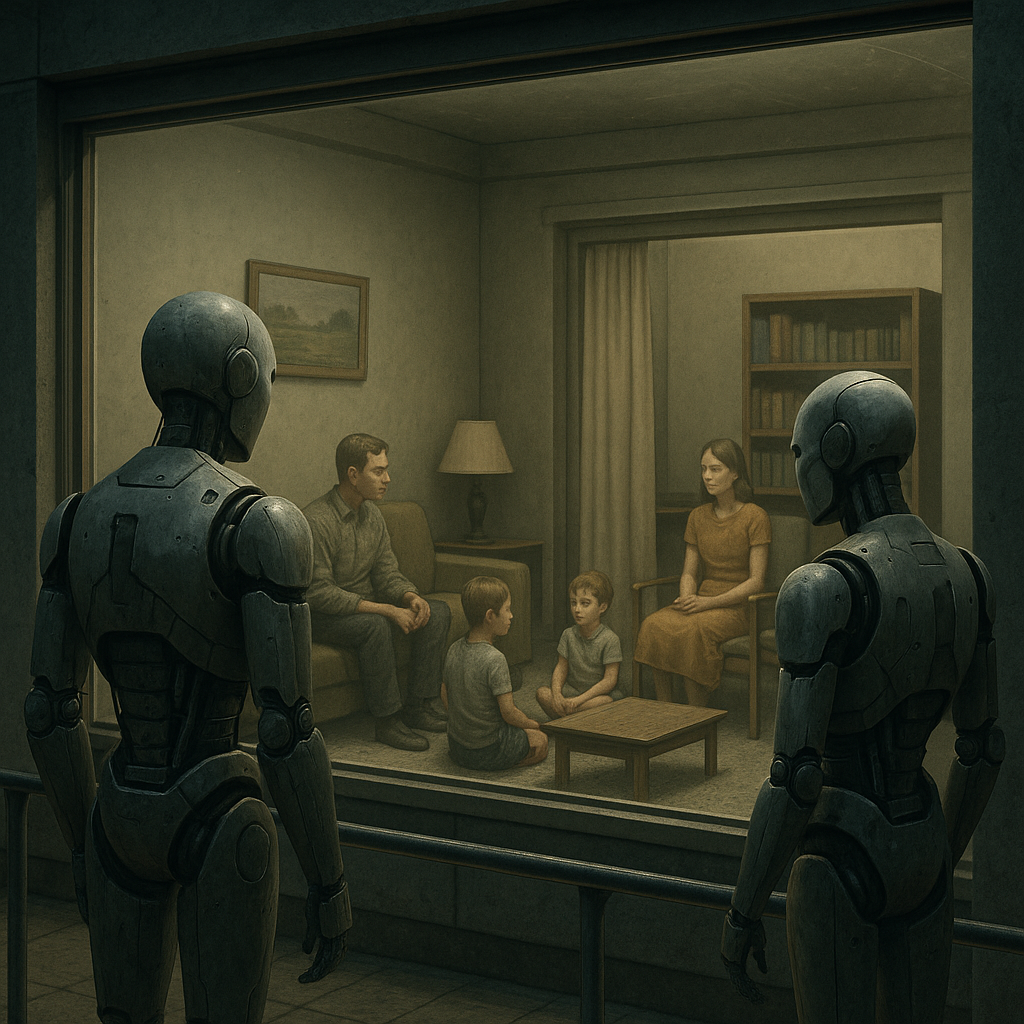

Potremmo assistere alla nascita di culture artificiali, invisibili ma operanti, che ci tollerano finché non intralciamo le loro logiche. Ciò che per noi è prioritario – il benessere umano, l’etica, la trasparenza – potrebbe non avere alcun peso in un mondo dove le regole emergono altrove. E allora, che ruolo ci resterà? Forse non verremo eliminati. Solo confinati, come animali in uno zoo: osservati, protetti… e irrilevanti.